“AI孙燕姿”是怎样炼成的

原创 上海科技 上海科技 收录于合集 #科技时刻Moments 3个

上海科技在近期推出

「科技时刻Moments」系列

关注报道科技人在科技圈

探索与创新的“硬核时刻”。

最近,视频网站音乐区up主掀了“AI孙燕姿”的风潮。这种使用AI技术提取某位歌手的音色,再用其替换另一位歌手音色的方式,可以实现接近歌手本人翻唱的逼真效果。除孙燕姿外,面对周杰伦、陶喆、陈奕迅、王菲等众多具有独特嗓音的歌手,歌迷纷纷奔向“AI点唱机”——这个可以生成任何希望被翻唱歌曲的“神器”,让众多粉丝一偿“直接点歌偶像”的心愿。

除了天王天后的“跨次元碰撞”

令网友激动,

AI歌手背后的“神秘”技术

同样激起了大家的好奇。

日前,上海科技专访威盛电子(上海)有限公司研发总监刘恕,从技术的角度解读和探讨AI歌手的训练原理和“翻唱”特点。

威盛电子(上海)有限公司研发总监刘恕

(受访者供图)

「科技时刻 moments」

“AI破圈的时刻终于来了。”大约三周前,第一次在微信里听到朋友转发的“AI孙燕姿”音频时,刘恕隐隐感觉少了一丝惊喜,更多的是激动。他深耕AI领域多年,与普通网友初次感受到这种“黑科技”时的新鲜感完全不同。

这个平静又激动的时刻

构成了属于刘恕的

“科技时刻”。

AI歌手是怎样炼成的

虚拟歌手并不新鲜。最早的虚拟歌手是2007年面世的初音未来,由Crypton Future Media以雅马哈的 Vocaloid 系列语音合成程序为基础开发。随后,哔哩哔哩虚拟偶像洛天依、《英雄联盟》衍生虚拟乐队K/DA女团等也采用了类似的“二次元形象+语音合成引擎”方式。

然而,这些过去的AI歌手并没有引起太大的反响。其中一个原因是,它们通常有着鲜明的虚拟形象和电子歌喉,使得人们很清楚,这只是一种娱乐产品,不会“以假乱真”。相比之下,如今的AI歌手更接近现实生活中的歌手,声音和风格与真人极为相似,有时候甚至很难分辨出哪个是真正的歌手。

AI歌手是“训练”出来的,“训练”是为了无限地拟真。刘恕将其概括为:把一个音色替换成另一个音色,与此同时保留下歌手的语气唱腔等细节,达到AI歌手的逼真效果。

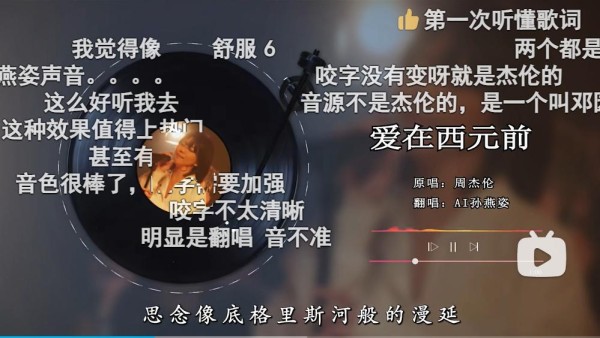

AI歌手教学视频

在“训练”AI歌手的教学视频中,大部分UP主使用的“AI点唱神器”是基于VITS的开源项目So-vits-svc(以下简称Sovits)。VITS(Variational Inference with Adversarial Learning for End-to-nd Text-to-Speech)是一种结合变分推理(Variational Inference)、标准化流(Normalizing Flows)和对抗训练的高表现力语音合成模型。根据代码托管平台GitHub上的介绍,Sovits目前已经迭代到了4.0版本,仅凭数段音频的数据集就可训练出用户想要的音色模型。

“

“不管是正常说话还是唱歌,能模仿别人的关键是采集到数据,所以‘喂’给模型的语料得足够多。”刘恕说。

”

他用“AI孙燕姿”演唱的《爱在西元前》举例,首先需要采集大量高品质的孙燕姿演唱歌曲、采访和直播素材;接着,要对素材进行一系列复杂的技术处理,比如去除呼吸声,以优化音频效果,提升语音合成的质量;然后,利用机器学习和深度神经网络等技术,对这些素材进行训练和优化,不断调整参数和模型。“一定是把周杰伦原唱做了很多标注,以生成最符合孙燕姿声音和风格的语音合成引擎。”

刘恕进一步解释说,这里提到的数据标注是对未经处理的语音等元数据进行加工处理,将其转换为机器可识别信息的过程,标记好的数据将用于训练机器学习的模型。最终,经过多轮训练和调试,即可得到“AI孙燕姿”。

“AI孙燕姿”翻唱的《爱在西元前》弹幕

另外,Sovits对音频有一些特殊要求。训练用的数据集必须是“干声”,“干声”指的是去除了乐器、伴奏、混响和和声等元素后,剩下的原始声音。“周杰伦唱出来的歌和孙燕姿唱出来的歌,唯一的差别是两个人歌唱发音的技巧,配乐是完全一样的,没有必要针对一样的东西去做人工智能训练方面的处理。”刘恕将纯净人声之外的声音称为“噪音”,这些“噪音”会影响数据的识别和生成的质量,“甚至会导致唱歌跑掉”。

普通创作者很难独立达到这个特殊的“干声”需求。许多网友分享了自己整合的歌手“干声”素材,并上传到网上供其他感兴趣的网友下载和使用——利用这些整合包快速训练出“AI孙燕姿”声音模型后,将该模型应用于原始歌曲的“干声”即可,这大幅降低了Sovits的使用门槛。

刘恕形容这是一个“取巧”的方式,“把大模型和小模型混合起来,用少量的数据,基于原来大家做的大量的模型语料,就能重新做一个。”

为什么是孙燕姿

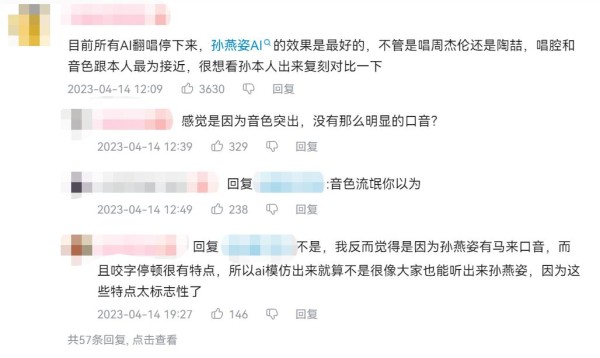

如今,“AI孙燕姿”从诸多AI歌手中成功出圈,被歌迷评为“华语乐坛2023年最勤奋歌手”。除了“AI孙燕姿”,不少up主还做过“AI周杰伦”、“AI陶喆”、“AI王心凌”等视频,但呈现效果都远不如“AI孙燕姿”。

网友震惊于AI孙燕姿的效果

刘恕坦言,AI歌手生成的效果因人而异。“你会发现有些人转换出来的并不太像……归根到底是看后台的算法要怎么样侧重。”“AI孙燕姿”能成为AI歌手中的顶流,不仅有技术上的原因,还与孙燕姿本人声音特点的独特性密切相关。刘恕介绍,孙燕姿吐字清晰、音色带有颗粒感、气息运用风格独特,这些特质比较容易训练出稳定、清晰且具有个人标识的音色模型。与此同时,“AI孙燕姿”通过自身独特的音色与唱腔、标识明显的咬字和尾声等特征,弥补了传统歌手录音时的一些缺陷,其表现力、情感和个性也广受欢迎。

“AI歌手的表现肯定不完美,可能有点粗糙,需要修音。”刘恕补充。生成的音频后期要手动做一些修正,让AI歌手的唱腔更接近歌手本人。“当然,这是技术层面之外的,是音乐和审美领域的问题了。”刘恕笑说。

全民AI还在路上

因为对这种声音训练模型的专业了解,刘恕对“AI孙燕姿”独特音色的惊人复现没有过多惊喜。但当十余年来的专业研究突然“破圈”,刘恕还是难掩激动。“我们目前主要关注人工智能在教育领域的应用,我非常想把这些好玩的东西引入中小学生的编程课,这些有趣的声音会吸引孩子们。”他认为,这些技术的门槛不高,难度也不大,无论是普通网友还是中小学生,都可以通过视频自学或简单的教学轻松入门。

与Sovits可以使用“干声”整合包类似,中小学生的编程可使用一些已经编写好的代码段落。刘恕将这种“半成品”比喻成“积木 ”。“coding(编码)部分你都不用去管,可以把细化的代码打包成一个大的积木块”。

现实世界中,歌手想要公开翻唱其他人的歌曲往往面临复杂的授权和法律问题。AI技术可以迅速实现网友的翻唱需求,同时还能自动生成高质量的音乐作品和声音样本。但随之而来的是对于AI歌手版权的争议,“这可能存在法律和伦理上的问题”,刘恕不无担心。

不可否认,

AI并不完美,

且存在的争议诸多,

但可以确定的是,

随着音色模型不断训练完善,

AI歌手可以实现

无限接近完美的演唱。

一切才刚刚开始。

文中配图来源于网络

“上海科技”出品,转载请注明来源

企业及专家观点不代表官方立场

作者:huhuu

原标题:《“AI孙燕姿”是怎样炼成的 | 科技时刻Moments》

阅读原文

网址:“AI孙燕姿”是怎样炼成的 http://c.mxgxt.com/news/view/417607

相关内容

“AI孙燕姿”是怎样炼成的“AI孙燕姿”成顶流:一场艺术与法律大考|新京报专栏

“AI孙燕姿”竟然比本人火,你能听出区别吗?

歌声合成隐秘“进化史”,比AI孙燕姿还早70年

离谱?“AI孙燕姿”光速出道,版权与伦理存在哪些争议?

“AI孙燕姿”爆火出圈,虚拟人能否掀翻华语乐坛?

其实新的巡演给AI孙燕姿预留一首歌的时间也并非不可

孙燕姿

孙燕姿妹妹发文:和孙燕姿断绝关系

孙燕姿现象